研究者が語るロボットの技術的基盤

はじめに

初めまして、ロボットをメインに志望している就活生です。自分の学びを兼ねて、記事を発信していきます。 最初の記事はものづくり系動画サイトarpezoTVの「インパクトある課題を解く、産業用ロボット的システム思考」を参考にして、記事を書いていきます。

Apérza TV(アペルザTV、アペルザテレビ)|製造業に特化した動画配信プラットフォーム

上の動画では、ロボットの視覚に関わる研究の第一人者である金出武雄教授がロボットの周辺技術や課題解決の考え方を説明されています。この記事では、この動画を要点を切り取りつつ、説明していきます。

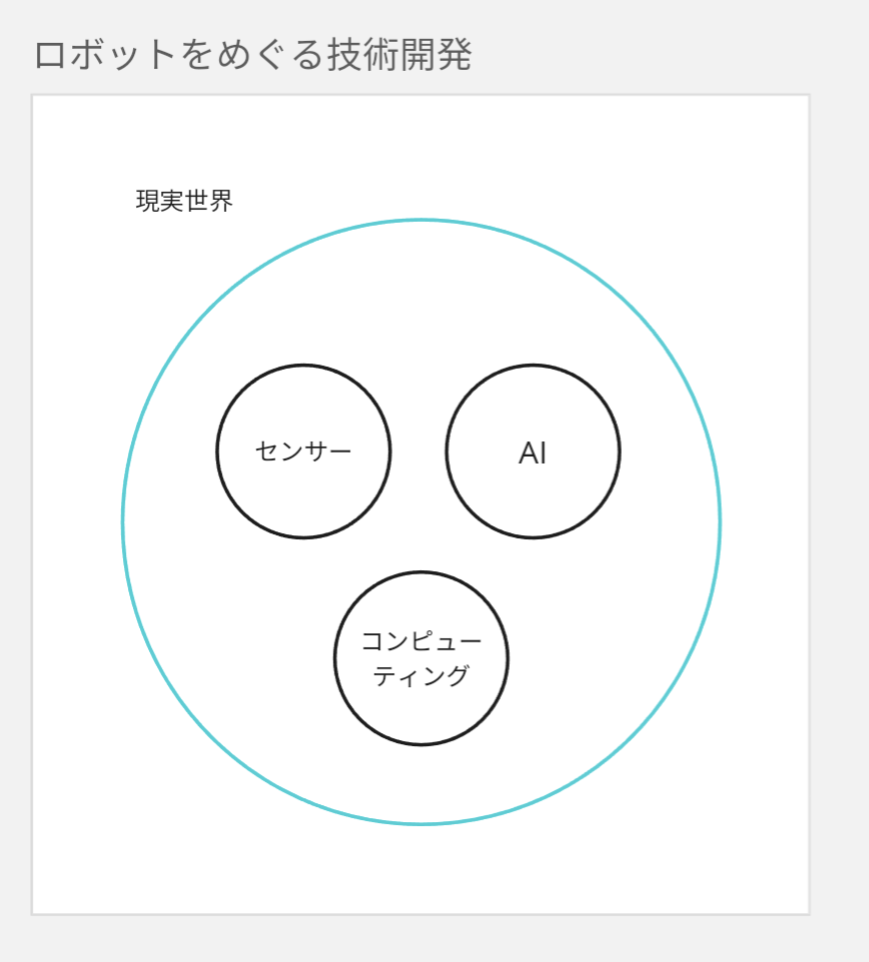

ロボットにおける3つの基盤

教授によれば、1AI/センサー/コンピュテーション、2デジタルツイン・シミュレーション、3高速通信・遠隔制御の3つの技術要素を開発することで、ロボットが社会に広くインパクトを与えると仰っています。これらは相互に補い合っているといえるでしょう。

▶︎AI/センサー/コンピューテーション

Deep learningなどによってAIはよりスマートになっています。現実世界の物体認識の能力は飛躍的に向上し、自動運転技術でも、産業用ロボットの仕分けなどに活用されています。

この現実世界の情報を得るのがセンサーです。人間よりも速く正確に情報を得ることができます。

そして、クラウドやエッジコンピューティングによって、高精度な予測やリアルタイムで実行に移すことが可能になります。

これらの例として教授が開発した自動運転の際の天候不良時に機能するヘッドライトです。開発に値する重要な理由として、ライトを照らしていた場合、人間が雨を認識する時は線のようになる一方で、コンピュータビジョンの世界ではフラッシュレートがより高いため、ライトに反射した大きな丸として視界を遮ってしまうからです。

この課題に対して、雨粒をそもそもヘッドライトの光に当てないという技術を開発し、解決しました。

まずクルマのヘッドライトを、プロジェクターとカメラとを同じ位置に設けて置き替えます。そして、光をプロジェクターで照射すると同時に、その反射をカメラで撮影し、光を反射する雨粒のある方向を計算し、その方向の光を即座にカットするのです。その結果、反射を大幅に抑えるヘッドライトシステムが見事、成功しました。ロボットに「目」を授けた男、金出武雄:Meet the Legend | WIRED.jp

まさに、センサーから得た情報を高速で処理するというものでした。

▶︎高速通信・遠隔制御

次にロボットが効率的・安全に動くことができるのは、高速通信によるところも大きいと教授は言います。 5Gや次世代通信技術を通じて、非常に低い遅延時間で自動運転のような実際の制御に関わります。他にも遠隔での制御やロボット操作に使われるようになります。 ロボットの遠隔操作を身近に、川崎重工とソニーが作ったリモートロボティクス:2022国際ロボット展 - MONOist

▶︎デジタルツイン・シミュレーション

こうした高速通信と深く関係するのが、デジタルツインだといいます。デジタルツインとは、簡単にいえば現実世界のコピーです。環境や物体、センサーといったモデルをバーチャルの世界に落とし込むことで、産業用ロボットのアルゴリズムを開発するといったことを、シミュレーションできるようになります。

こうした三要素が使われているものとして、自動運転技術でトップクラスの企業Waymoを例に挙げてみましょう。 まずミリ波レーダー(電波)、LiDAR(光)、360度のビジョンシステムで構成されるセンサーを数多く使い、Waymoは物体と空間を認識し、制御していきます。そして、高速通信によってバーチャルのマップを作成すれば、走行の安全性の確保のほかアルゴリズム開発などに役立たせることができます。 以下のブログでかなり詳細に解説されていますので興味があればご覧ください。 https://justinkek.medium.com/alphabets-waymo-a-technical-study-on-autonomous-vehicle-tech-c128180ab2c5https://justinkek.medium.com/alphabets-waymo-a-technical-study-on-autonomous-vehicle-tech-c128180ab2c5 こうした技術インフラが進むことで、ロボットもより高精度で安全性の高いものとなっていくでしょう。

ロボット的システム思考

動画の最後に、ロボット開発の考え方として教訓を3つ語られていますが、ここでは2つ取り上げます。

①システム全体を見つめた開発 部分だけでは成功するわけではないと論じられています。今やロボットは工場に置くものだけでなく、サービスロボットとして活用されたり、ビジネスにおいて企画から販売といった様々なフェーズがあります。そうしたシステムとして全体を見据えたロボットが必要になると考えられます。

②人がやっているように見えることをAIでそのまま置き換えるのは失敗になる 教授は目視検査の例を挙げています。ただ、画像をセンサーで取得し、分析すると失敗するケースが多いとのこと。目視検査はただ見るのではなく、透かすや触るとかの語感が必要になると仰います。上のWIREDの記事の後半に書いてありましたが、柔軟な発想が求められると思いました。

また別のところで語られていましたが、ロボットをそのまま導入するのではなく、ロボットフレンドリーな環境に整えていくことも重要な気がしました。例えば、運搬ロボットを導入しようとする物流施設であっても、狭すぎると機能しないといったことが起こり得ると思いました。

こうした考え方がよりインパクトのあるロボットの開発・活用に繋がっていくいと考えられます。

まとめ

金出教授の動画をまとめてみました。ロボットでも、センシングやAIによる処理・制御は重要だと思うので個別に取り上げたいと思います。ご覧頂きありがとうございました。